Codex CLIでLM Studio経由のローカルLLMを設定

Codex CLIは、OpenAIが提供(リリース:2025年4月)しているコーディング支援ツールです。

公式サイト:https://developers.openai.com/codex/cli

Codex CLIの主な特徴

Codex CLIの主な特徴は下表のような内容になっております。

- プログラマー向けのツール

- ローカル環境のターミナル(CLI)上で動作する

- 自然言語を使ってコードの生成や編集ができる

- Apache 2.0ライセンスでソースコードがgithub.com/openai/gpt-ossに公開されている

Codex CLIでLM Studio経由のローカルLLMを設定

Codex CLIでLM Studio経由のローカルLLMを設定する場合の手順を紹介いたします。

前提は

- ローカル環境(メモリは32GB以上を推奨)にLM Studioをインストールしている。

- LM StudioでローカルLLMのモデル「openai/gpt-oss:20b」をインストールしている。

参考記事:LM Studioの導入 - Node.jsがパソコン上で実行可能になっている。

- pythonがパソコン上で実行可能になっている。(サンプルを実行する時に使用)

としています。

※他のモデルを設定の場合は、モデル名を読み替えていただければと思います。

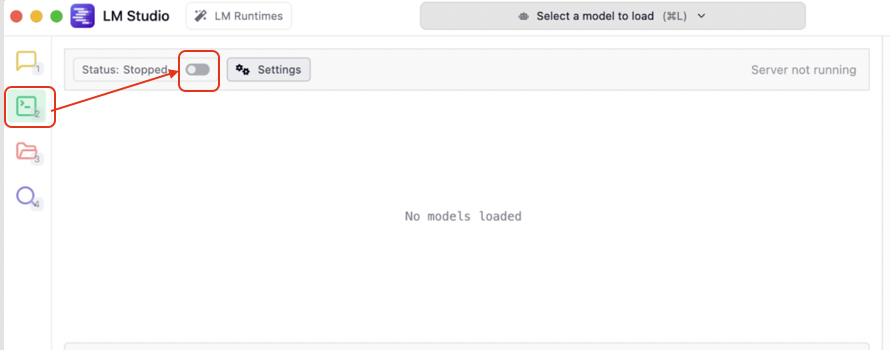

1.LM Studioをサーバーとして起動

- LM Studioを起動して、左メニューの緑色アイコンの「Developer」をクリックします。

画面の上部にAPIサーバー起動用のトグルボタンがあります。

図. LM Studioで「Developer」をクリック - サーバー起動用のトグルをクリックします。

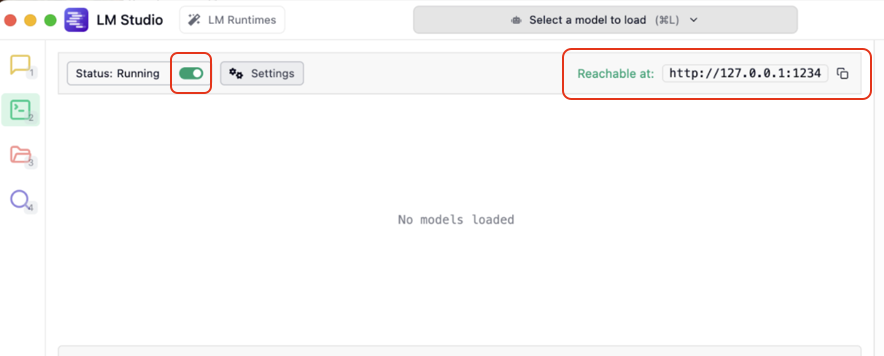

トグルがONの状態になって、右側に起動していることを示すサーバーのアドレスが表示されます。

図. LM StudioをAPIサーバーとして起動

2.LM Studioでモデルのコンテキスト長の変更

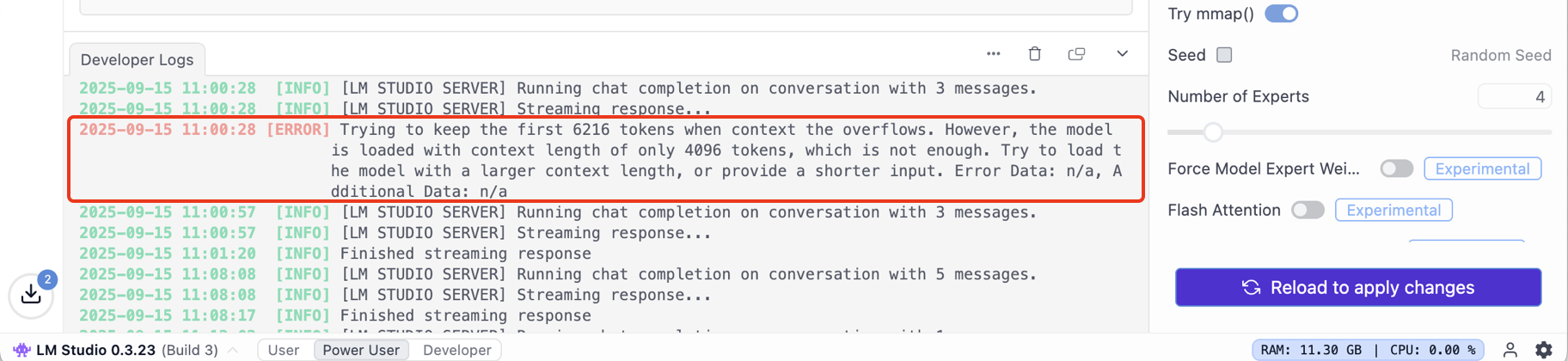

- 使用するモデルが「gpt-oss-20b」の場合、コンテキスト長はデフォルトで4096になっています。

この場合はCodex CLIの実行時に下記のようなエラーが表示されるため、コンテキスト長を増やします。

エラーはLM Studioの「Developer」の「Developer Logs」で確認ができます。Trying to keep the first 6216 tokens when context the overflows. However, the model is loaded with context length of only 4096 tokens, which is not enough. Try to load the model with a larger context length, or provide a shorter input. Error Data: n/a, Additional Data: n/a

図. コンテキスト長不足のエラーメッセージ 手順は

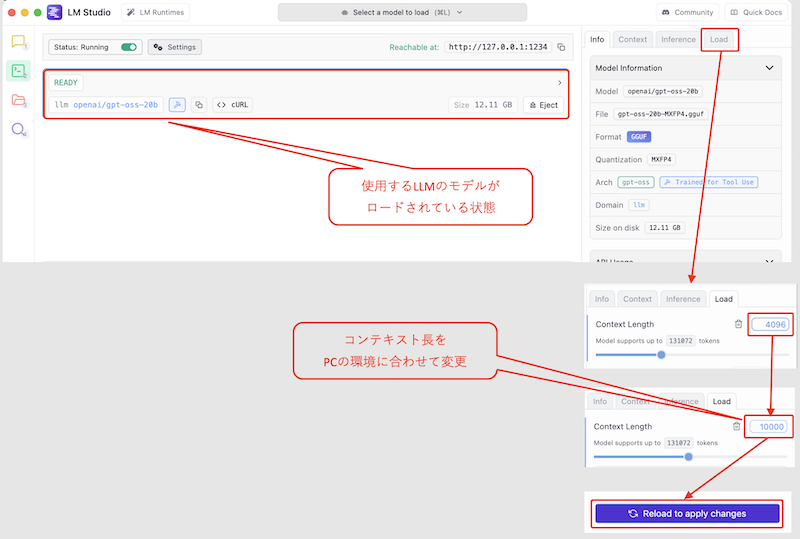

- 「Developer」の画面でロードされているLLMモデルの右側の「Load」タブをクリック

- 「Context Length」でデフォルトの「4096」の数値を変更(ここでは例として「10000」に設定)

- 画面下部の「Reload to apply changes」(変更を適用するには再読み込み)をクリック

の流れで、下図のように反映します。

図. コンテキスト長の変更

3.Codex CLIのインストール

-

- 公式の手順に沿って、macOSの場合はターミナル(Windowsの場合はPowerShell)でCodex CLIをインストールします。

npm install -g @openai/codex # または、Homebrewが使用できる場合 brew install codex - インストール後にバージョンを確認します。

codex --version # 下記のように表示されていればインストールは成功 codex-cli 0.34.0

- 公式の手順に沿って、macOSの場合はターミナル(Windowsの場合はPowerShell)でCodex CLIをインストールします。

4.Codex CLIのプロファイル設定

- LM Studio経由のローカルLLMを使用するための設定を行います。

ここでは複数のプロファイル設定を今後行うことを意識して、codexの起動は下記で行う想定とします。codex --profile gpt-oss-20bそれを実現させるために、下記のプロファイル設定を行います。

# ~/.codexのディレクトリが存在しない場合は生成 mkdir ~/.codex # プロファイルの定義ファイルを編集 vi ~/.codex/config.tomlconfig.tomlの編集ができる状態で、下記の内容を「~/.codex/config.toml」に反映します。

# LM Studio(ローカル) [model_providers.lmstudio] name = "LM Studio" base_url = "http://localhost:1234/v1" api_key = "lm-studio" [profiles.gpt-oss-20b] model_provider = "lmstudio" model = "openai/gpt-oss-20b"

5.Codex CLIの動作確認

- PCに任意のディレクトリを作成して、macOSの場合はターミナル(Windowsの場合はPowerShell)でその場所に移動します。

例えばディスクトップに「codex_test01」というディレクトリを作成する場合は、下記のように行います。cd ~/Desktop/ mkdir codex_test01 cd codex_test01 - 「codex –profile gpt-oss-20b」でCodex CLIを起動すると、下記のようなメッセージになります。

$ codex --profile gpt-oss-20b >_ Welcome to Codex, OpenAI's command-line coding agent > You are running Codex in /Users/user01/Desktop/codex_test01 Since this folder is not version controlled, we recommend requiring approval of all edits and commands. 1. Allow Codex to work in this folder without asking for approval > 2. Require approval of edits and commands Press Enter to continue選択肢の意味は

- 1. Allow Codex to work in this folder without asking for approval:

このフォルダ内では、Codexが自動で編集・実行できるようになります(信頼済みワークスペース) - 2. Require approval of edits and commands:

Codexが何か変更・実行しようとするたびに、ユーザーの確認が必要になります(安全重視)

になっています。

ここでは1を選択してEnterキーをクリックしていくこととします。 - 1. Allow Codex to work in this folder without asking for approval:

- 画面がかわり、自然言語による指示ができる状態になりました。

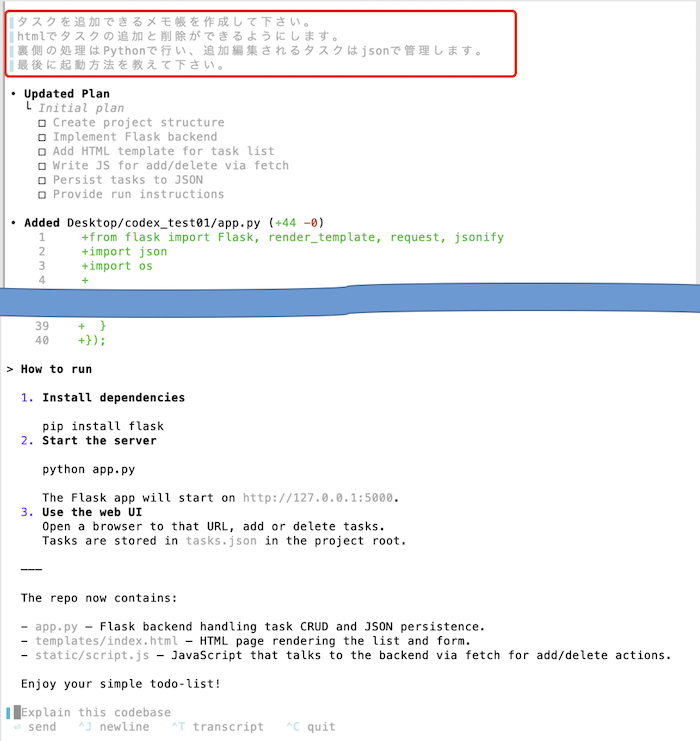

>_ You are using OpenAI Codex in ~/Desktop/codex_test03 To get started, describe a task or try one of these commands: /init - create an AGENTS.md file with instructions for Codex /status - show current session configuration and token usage /approvals - choose what Codex can do without approval /model - choose what model and reasoning effort to use ▌ Improve documentation in @filename ⏎ send ⌃J newline ⌃T transcript ⌃C quitここでは例としまして、下記のように入力してEnterキーをクリックします。

タスクを追加できるメモ帳を作成して下さい。 htmlでタスクの追加と削除ができるようにします。 裏側の処理はPythonで行い、追加編集されるタスクはjsonで管理します。 最後に起動方法を教えて下さい。 - 処理が進行して下図のような状態になりました。

図. Codex-CLIの実行例 ここではURLによる起動(PythonのFlaskを使用)を行うため、一旦「Ctrl + C」でCodex CLIを終了します。

「ls -R」等のコマンドで、Codex CLIが生成してくれたファイルが確認できます。

$ ls -R app.py static tasks.json templates ./static: script.js ./templates: index.html※Visual Studio Code(VS Code)等のコードエディターでの確認も推奨です。

次に使用されるflask(PythonのWebアプリケーションフレームワーク)がパソコンで動作できるかを確認します。

ターミナルで「flask –version」を実行した時にバージョン情報が確認できない場合は、下記のコマンドでインストールを行います。$ pip install flask または $ pip3 install flask次に画面の指示にしたがって、下記のコマンドを実行します。

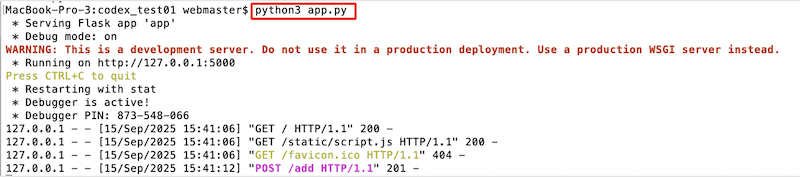

$ python app.py # または $ python3 app.py実行すると下図のような「http://127.0.0.1:5000/」で起動ができるメッセージが表示されました。

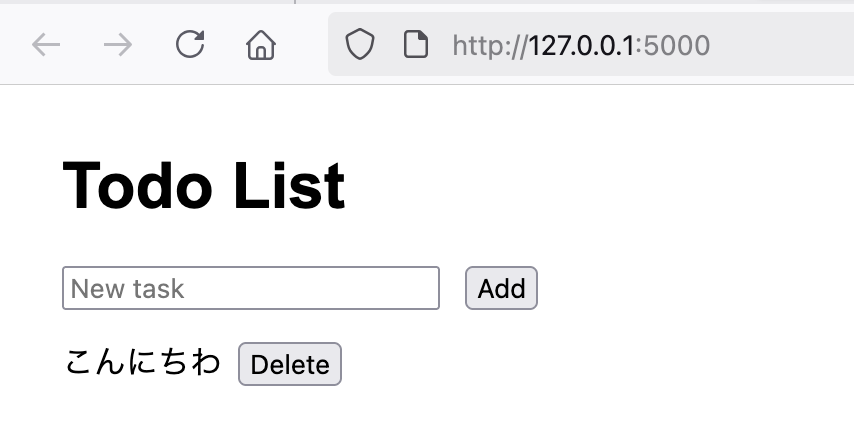

図. Codex-CLIの実行例 - ブラウザで動作確認を行います。

下図のように表示されて動作確認ができました。

図. Codex-CLIの実行例